Mehr Context, bessere Ergebnisse?

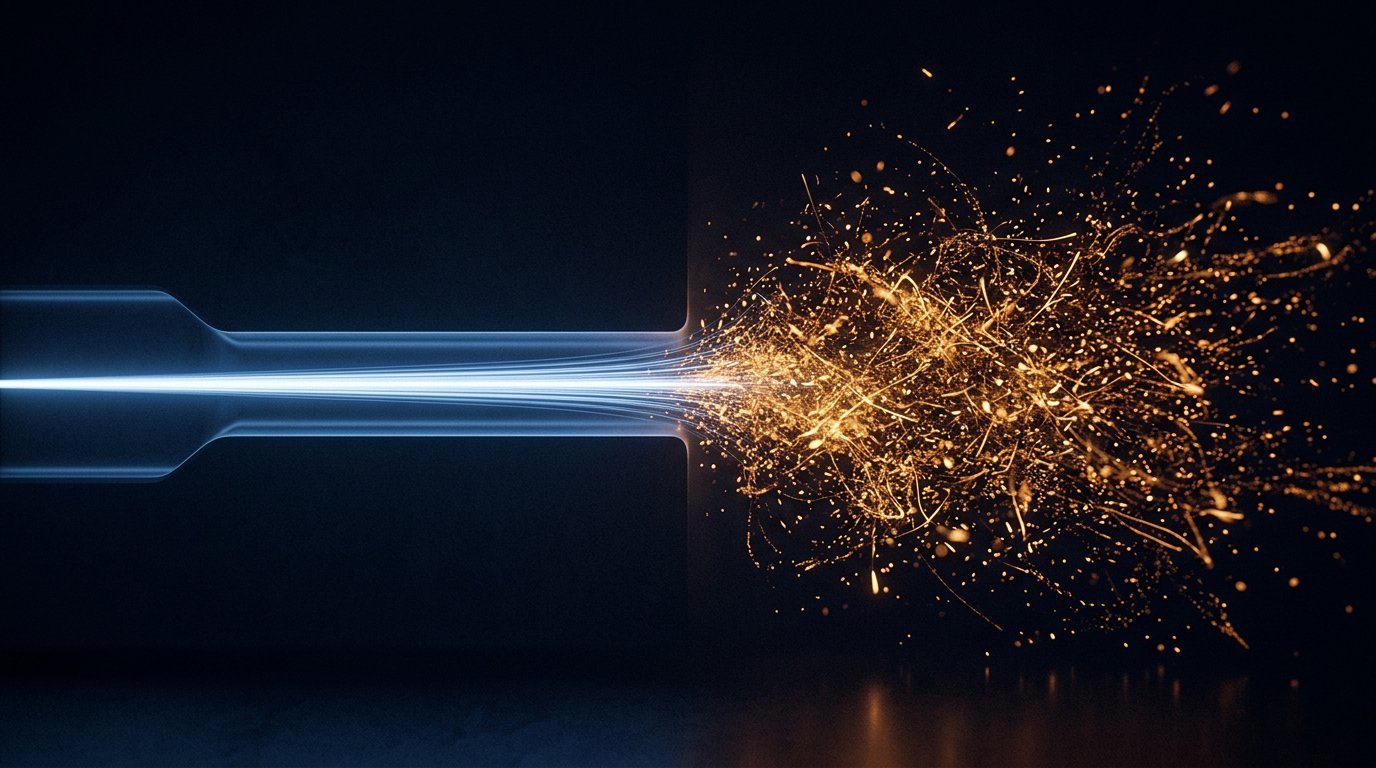

Warum zu viel Kontext die KI-Qualität killt.

Context ist gut. Context ist wichtig. Aber ab einem bestimmten Punkt kippt es – und das Modell liefert schlechtere Ergebnisse, nicht bessere.

„Gib dem Modell so viel Context wie möglich." Das hört man überall. Und es stimmt – bis zu einem gewissen Punkt. Wer relevante Dateien, Architekturentscheidungen und Konventionen mitgibt, bekommt spürbar bessere Ergebnisse. Das Modell rät weniger, der Output passt besser.

Aber irgendwann dreht sich der Effekt um.

Der Kipp-Punkt

Sprachmodelle haben ein endliches Context Window. Und selbst innerhalb dieses Fensters ist die Aufmerksamkeit nicht gleichmäßig verteilt. Informationen in der Mitte eines langen Kontexts werden schlechter verarbeitet als solche am Anfang oder Ende – das Lost-in-the-Middle-Problem ist gut dokumentiert.

Dazu kommt: Je mehr irrelevantes Zeug im Context liegt, desto schwerer wird es für das Modell, das Wesentliche zu finden. Was dann passiert:

- Wichtige Details gehen unter. Das Modell verteilt seine Aufmerksamkeit auf zu viele Stellen gleichzeitig.

- Widersprüche entstehen. Alter und neuer Context sagen verschiedene Dinge, das Modell bastelt einen Kompromiss zusammen.

- Der Output wird beliebig. Statt konkreter Antworten kommen vage, abgesicherte Formulierungen.

Mehr Context hilft also nur, solange er relevant ist. Ab dem Punkt, wo Noise das Signal überlagert, schadet er.

Was gehört rein, was nicht?

Nicht alles, was du weißt, muss ins Prompt. Die Frage ist: Was braucht das Modell für genau diese Aufgabe?

- Architekturentscheidungen: Ja, wenn sie die aktuelle Aufgabe betreffen.

- Coding Conventions: Ja, kompakt als Rules oder System Prompt.

- Der gesamte Chatverlauf der letzten Stunde: Meistens nein.

- Drei Dateien „zur Sicherheit": Nur wenn alle drei für die Aufgabe relevant sind.

Was in der Praxis am meisten bringt

1. Context Compaction.

Den Kontext verdichten, statt wachsen lassen. Das Modell braucht nicht deinen gesamten Recherche-Verlauf – es braucht das Ergebnis. Zwischenstände zusammenfassen, irrelevante Seitenäste rauswerfen, dann weitermachen.

2. Frischer Context an der richtigen Stelle.

Bewusst den Context leeren und neu starten. Das ist einer der Tipps, die sich erst falsch anfühlen – aber einen riesigen Unterschied machen.

- Plan → Execute: Erst einen Plan erstellen, mit vollem Context. Dann eine neue Session starten und den Plan abarbeiten lassen. Der ganze Recherche-Ballast bleibt draußen, das Modell fokussiert auf die Umsetzung.

- Vor Design-Entscheidungen: Wenn du von Backend-Logik zu Frontend/Design wechselst – neue Session. Sonst ist das Modell durch die vorherige technische Diskussion vorbelastet und trifft ästhetische Entscheidungen mit dem falschen Kontext im Kopf.

- Nach Debugging-Sessions: Der Context ist dann voll mit Fehlversuchen und Sackgassen. Neustart mit nur der Lösung bringt mehr als weitermachen.

Context-Management ist eine aktive Entscheidung. Wer es dem Zufall überlässt, verschenkt Qualität.

Mehr Context heißt nicht automatisch bessere Ergebnisse. Ab einem Punkt kippt es. Wer aktiv verdichtet und an den richtigen Stellen mit leerem Context neu startet, holt deutlich mehr aus demselben Modell raus.

Weiterlesen

Wie strukturiertes Arbeiten mit KI in der Praxis aussieht: